App 部署方式一直是技术领域的关键议题,传统部署模式面临诸多难题,新的部署模式虽有优势却也伴随着新挑战。究竟如何抉择?下面为你详细剖析。

传统部署困境

传统的 App 部署模式,需要大量服务器。一个典型 App 要满足数十个应用服务实例以及上百个数据库和缓存实例的需求,至少得数十台服务器。若想进一步提高服务器利用率,还得用不同规格服务器部署不同实例,或是进行混部,这无疑提升了管理复杂度,让服务部署、成本评估等工作变得困难。

实际中,不少企业为了一个业务的部署,采购了各式各样的服务器,不同规格服务器间的协调管理让人头疼,稍有不慎就可能出现资源浪费或不足的情况。

小实例大问题

为了便于管理,业务往往选能满足需求的最小实例,这就导致要大量不同规格服务器。应用服务因业务逻辑不同,所需 CPU 核心数和内存差异明显,比如 6 核 8GB、8 核 12GB 等,就算标准化后比例也复杂如 1:1.33 等。

这些不同规格服务器增加了管理难度,运维人员要时刻关注每台服务器的状态,资源分配和调度变得异常繁琐,一不小心就可能出错。

虚拟化之殇

以往常用虚拟化方案切分资源,但它有额外开销。Hypervisor、Guest OS 等都会消耗额外 CPU 和内存,在虚拟机中运行应用性能不如宿主机。

在某公司的项目中,使用虚拟化部署后,应用响应变慢,处理任务效率降低,严重影响了业务的正常开展,不得不寻找其他解决方案。

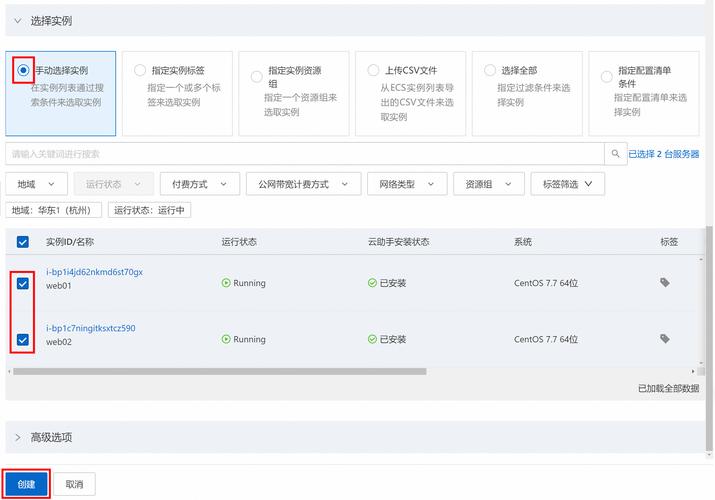

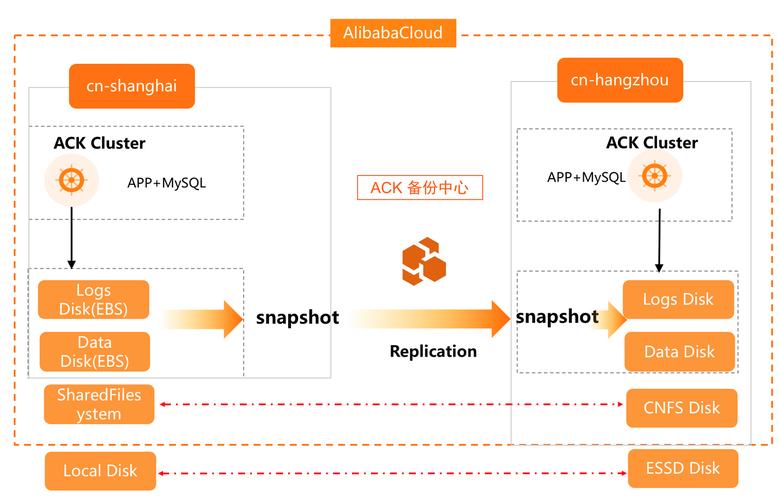

Kubernetes 混部优势

通过 Kubernetes 进行不同缓存、数据库、应用服务的搭配混部,能充分利用单台服务器的 CPU 和内存。搭配多种 CPU 核心数与内存比的服务器,可满足业务对计算资源和内存的不同需求。

国内某互联网大厂,采用 Kubernetes 混部后,服务器利用率大幅提高,节省了大量的硬件成本,让资源得到了更有效的利用。

新问题突显

新部署方式虽好,但也有新问题。随着单台服务器部署负载增加,不绑核只限定 CPU、内存使用量的方式使 CPU 调度开销增大;网络对 RPC、缓存的请求增多,网络请求开销也变大。

在一些高并发业务场景下,这种开销的增加影响明显,服务器性能下降,可能导致部分服务响应不及时,影响用户体验。

性能提升成果

在特殊规格服务器上,借助基于本地优先调用的负载均衡策略,单机可部署更多数量和类型的服务,部分核心接口平均耗时和 P99 时间比传统部署方式下降 10% 以上,低流量时段能降 30%。

如某电商平台在促销期间,采用新部署方式,重要页面加载速度明显加快,用户购物体验更好,也提升了转化率。

现在请大家思考一下,在你的实际工作中,若遇到 App 部署难题,会倾向于哪种解决方案?欢迎评论分享,并点赞支持。